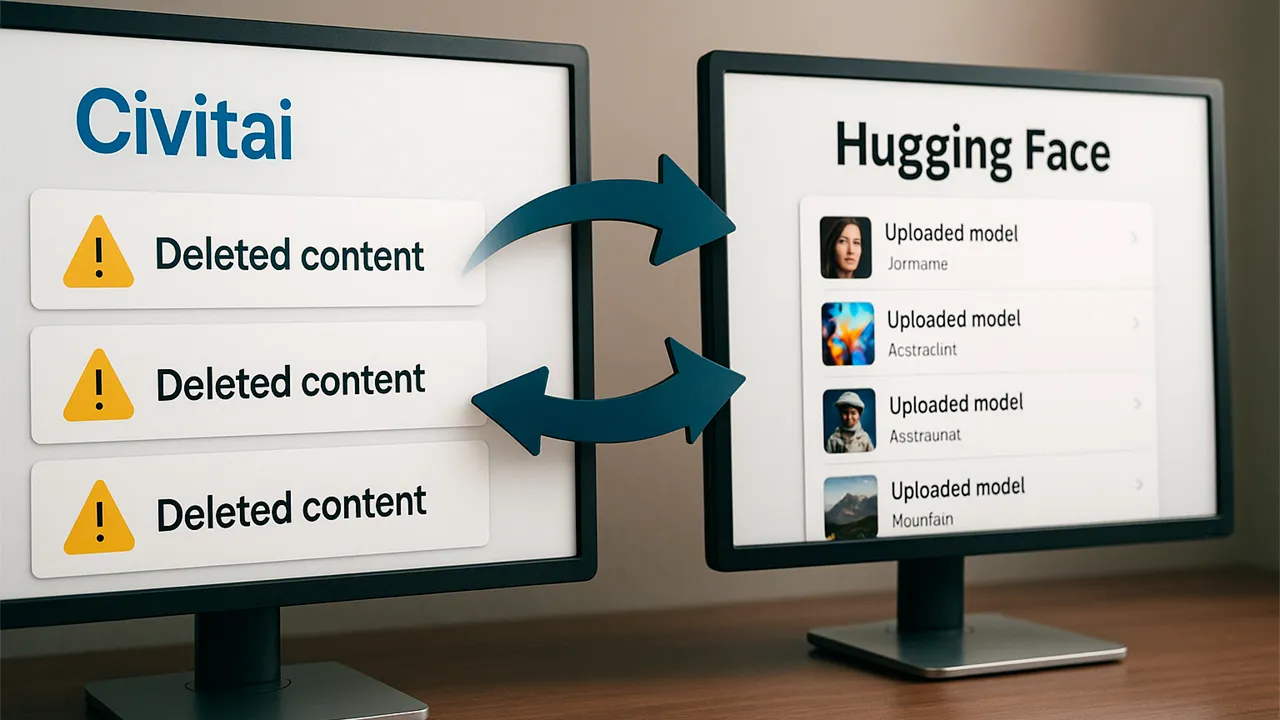

Hugging Face accoglie modelli AI rimossi da Civitai

L’estate 2025 ha visto uno scandalo legato ai modelli AI deepfake capaci di generare immagini di volti reali, con Civitai che ha rimosso oltre 5.000 modelli per tutelare la privacy e contrastare abusi. Tuttavia, questi modelli sono stati rapidamente caricati su Hugging Face, piattaforma con politiche più aperte, creando un acceso confronto tra le strategie di moderazione e sollevando questioni di responsabilità e regolamentazione. La community dell’AI, tramite canali come Discord, ha favorito la diffusione e il re-upload dei modelli rimossi, riflettendo la complessità del controllo in un ambiente decentralizzato e la difficoltà di bilanciare libertà di ricerca e tutela dei diritti individuali.

Le sfide etiche riguardano il consenso nell’uso di dati biometrici, i rischi di disinformazione e impieghi malevoli dei deepfake, e il confine sottile tra creazione originale e riproduzione non autorizzata. Nel dibattito giuridico emergono divisioni tra chi auspica regolamentazioni stringenti e chi teme l’ostruzionismo al progresso scientifico, con il GDPR e leggi attuali insufficienti a normare adeguatamente l’AI generativa. Le piattaforme dimostrano di non avere ancora strumenti efficaci per garantire un controllo completo, rendendo urgente l’elaborazione di normative internazionali aggiornate e bilanciate.

L’impatto sulla ricerca è duplice: mentre la protezione della privacy è fondamentale, una regolamentazione eccessiva può frenare iniziative benefiche e creative. Le proposte includono sistemi di tracciamento del consenso, maggiore trasparenza, strumenti veloci per la rimozione dei modelli abusivi e tavoli tecnici internazionali per definire policy condivise. Solo coordinando responsabilità, trasparenza e innovazione sarà possibile costruire un ecosistema AI che sia sostenibile, etico e rispettoso, superando la frammentarietà attuale e le fughe di modelli tra piattaforme diverse.